오늘의 요약

- Qwen3.5-397B-A17B 오픈가중치 발표

- vLLM, Qwen3.5 Day-0 지원 공개

- OpenAI, OpenClaw 인수 흐름 확산

- ChatGPT Lockdown Mode로 공격면 축소

- 중국 CNY 모델 러시·로보틱스 가속

알리바바, Qwen3.5-397B-A17B 오픈 가중치 공개

헤드라인: 알리바바, Qwen3.5-397B-A17B 오픈 가중치 공개

우리가 예상했던 대로 Pete Steinberger가 OpenAI에 합류했다. 더 덧붙일 말은 많지 않다.

오늘의 헤드라이너는 Qwen 3.5다. 다른 중국 모델 랩들인 Z.ai, Minimax, Kimi처럼 주력 모델을 리프레시하는 흐름을 따른 셈인데, 앞의 두 곳과 달리 Qwen 3.5는 Kimi와 같은 체급(400B)이다. 다만 Kimi의 더 공격적인 3.25% 대신, 약 4.3%의 sparsity ratio(희소성 비율)를 갖는다. 전 분야 SOTA를 주장하진 않으며, 특히 코딩 벤치마크 전반의 SOTA를 내세우진 않는다. 그럼에도 Qwen3-Max와 Qwen3-VL 대비 탄탄한 개선을 보여준다.

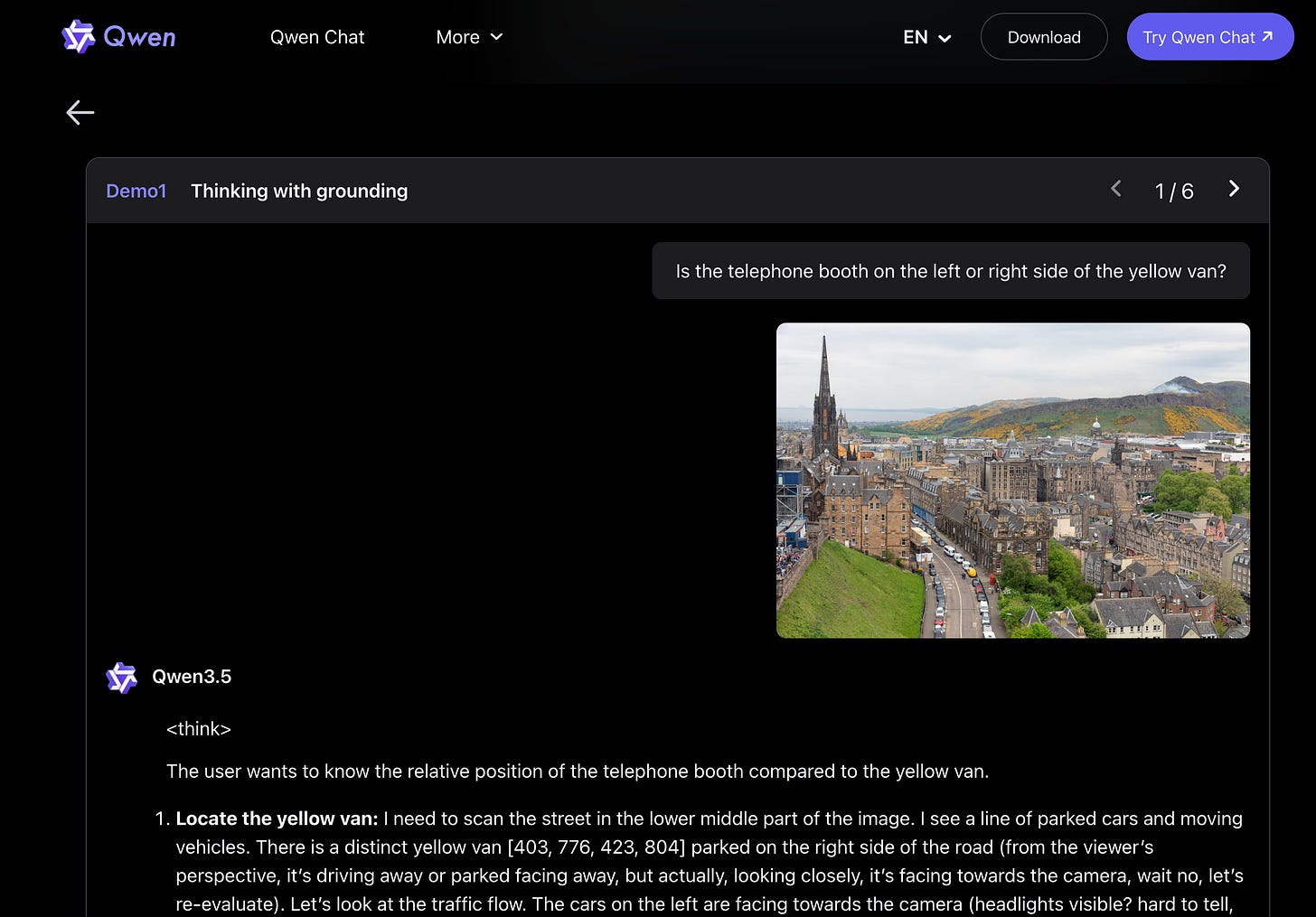

네이티브 멀티모달(native multimodality)과 Spatial Intelligence가 대표 기능이며, 예시를 보려면 블로그를 직접 클릭해 보길 권한다. 길게 할 말이 많지 않을 정도로, 중국에서 가장 다작(prolific)인 오픈 모델 랩이 내놓은 반가운 헤드라인급 모델 리프레시이고, 아마 DeepSeek v4 전에 마지막일 가능성이 크다.

원문 메타 링크: 544 Twitters · AINews’ website · AINews is now a section of Latent Space · opt in/out

원문 메타 링크(반복): 544 Twitters · AINews’ website · AINews is now a section of Latent Space · opt in/out

AI Twitter Recap

Alibaba’s Qwen3.5 open-weight “frontier MoE” drop (and the inference/infra fallout)

-

Qwen3.5-397B-A17B release: 알리바바가 Qwen3.5-397B-A17B를 출시했으며, Qwen3.5 시리즈의 첫 오픈 가중치(open-weight) 모델로 포지셔닝했다: native multimodal, “thinking and non-thinking modes,” hybrid linear attention + sparse MoE, “large-scale RL environment scaling,” 201 languages, Apache-2.0 (official announcement; also echoed by @JustinLin610). 또한 Qwen3.5-Plus는 동일한 베이스 모델의 호스티드 API 버전이며, 1M context(모델 네이티브 256K 대비)와 검색/코드 인터프리터 통합을 제공한다고 명확히 했다(clarification).

-

Architecture + KV-cache implications: 커뮤니티 논의는 장문 컨텍스트에서 추론(inference)을 감당 가능한 수준으로 유지하는 이유로 Gated Delta Networks / “GatedDeltaNet” + sparse MoE에 집중했다. vLLM은 day-0 support를 제공했고, 총 397B, 활성 17B, 멀티모달, 처리량/지연 이점을 강조했다(vLLM recipe). KV-cache에 대한 간단한 역산(back-of-the-envelope)에서는 KV head 수가 적고 gated-delta 레이어가 많아 ~31KB/token, BF16 기준 262K context에서 ~8.05GB KV(FP8에선 ~4GB)라는 추정이 제시됐다(KV math).

-

Deployment reality: huge weights, but surprisingly runnable: “~800GB BF16” 규모임에도, Apple Silicon에서 MLX/Q4로 로컬 구동했다는 보고가 나왔다(예: ~225GB RAM 언급)(mlx report; awnihannun demo). Unsloth는 “256GB Mac/RAM에서 4-bit로 돌리기” 가이드를 내세우며 최상위 폐쇄형 모델과의 동급(parity)을 주장했다(마케팅 주장이나 채택 관점에선 중요)(Unsloth). Ollama도 빠르게 클라우드에 올렸다(Ollama).

-

Benchmarks + “agentic RL” vs efficiency questions: 초기 평은 Qwen3-Max 및 이전 Qwen VL 모델 대비 한 단계 상승으로 보며, 특히 vision 개선이 눈에 띈다는 쪽이 있었다. 반면 점수 자체보다 “reasoning efficiency” 근거를 요구하는 반응도 있었다(scaling01). teortaxesTex는 일부 보고된 harness에서 Qwen3-Max-thinking보다 의외로 높은 점수를 낸다고 언급하며 agentic RL 때문일 수 있다고 추정했다(commentary). 동시에 “black-box eval” 비판과 과제별 실패(예: SVG / “Vending-Bench” 스타일 테스트)도 거론됐다(Vending-Bench claim; SVG comparisons).

-

Pricing drama: 추론 효율 주장 대비 알리바바의 API pricing이 높거나 이상하다는 글이 다수였고, Kimi/GLM과의 비교도 이어졌다(pricing complaint; more). 반복되는 요지는 “훌륭한 모델이지만, 서빙 비용(serve-cost) 이야기는 불명확”이다.

Open agents, “harness engineering,” and the OpenClaw → OpenAI saga

-

OpenClaw as a proof-point for one-person leverage: OpenClaw 사례는 “1인 팀 + 코딩 에이전트”가 매우 빠르게 세상을 바꿀 만한 것을 만든다는 상징으로 이야기되며, Peter Steinberger의 OpenAI 합류/인수로 귀결된다고 프레이밍된다(Yuchenj_UW). 이 스레드는 인수 이후 OpenAI가 오픈소스를 어떻게 다룰지에 대한 논의도 촉발했다.

-

Anthropic/open-source tensions: Anthropic의 오픈소스에 대한 태도를 비판하는 담론이 크게 형성됐고, 제한/차단이 개발자를 다른 모델/프로바이더로 밀어냈다는 주장도 나왔다(ThePrimeagen; Teknium). 반대로 “일주일이면 vibe-coded로 만들 수 있다”는 식으로 전략적 영향은 과장이라는 반응도 있었지만, OSS 커뮤니티에서의 평판 비용은 인정하는 분위기도 있었다(scaling01). 한편 Anthropic은 Bengaluru 오피스를 포함한 대규모 운영 확장을 발표했고, 인도를 Claude.ai의 두 번째로 큰 시장으로 언급했다(Anthropic).

-

Harness as the real moat: 여러 트윗이 실무적 테제로 수렴한다: 에이전트의 차이는 모델 자체만이 아니라 “harness”(툴링, 컨텍스트 관리, 라이프사이클, 스킬, 평가/관측 가능성)라는 누적되는 인프라(복리 효과)이며, 점점 핵심 차별점이 된다는 주장이다. Ben Burtenshaw가 harness를 모델 주변의 “OS”로 정의하고, 폐쇄형 에이전트가 더 좋아 보이는 이유 중 하나가 모델이 harness 패턴에 대해 학습되기 때문일 수 있다는 이야기로 이어진다(ben_burtenshaw). 실제 에이전트 시스템을 만드는 실무자들도 “좋은 harness를 만드는 건 어렵고 시간이 갈수록 누적된다”고 말한다(brivael).

-

Lightweight agent alternatives: “큰 harness” 사고와 함께, 최소 에이전트 스택에 대한 관심도 있다. PicoClaw와 nanobot은 OpenClaw의 훨씬 작은 대안으로 소개되며, 여러 모델 백엔드와 MCP/vLLM을 지원한다고 한다(TheTuringPost).

-

Agent observability/evals becoming table stakes: LangChain/LangSmith는 에이전트에서 trace가 새로운 “stack trace”가 되었고 디버깅은 관측가능성(Observability) 우선 툴링이 필요하다는 메시지를 밀고 있다(meetup; tracing plug-ins). 이는 현재 에이전트 행동이 결정론적이지 않고 지속적인 모니터링이 필요하다는 불만과 맞닿아 있다.

OpenAI/Codex usage surge, sub-agents, and security hardening

-

Codex adoption claims: Sam Altman은 올해 초 이후 Codex 주간 사용자 수가 3배가 됐다고 보고했다(sama). 여러 커뮤니티 글은 병렬성/서브에이전트를 통해 Codex 5.3이 특히 “큰 도약”을 보였다고 묘사한다(gdb; “agents are up”).

-

Sub-agent configuration + model-tier tradeoffs: 실무 팁으로는 설정(예:

max_threads = 24)을 수정해 Codex 서브에이전트를 늘리는 Pro 사용자 트윅이 공유됐다(Hangsiin). 한편 어떤 사용자는 5.3-codex-spark가 더 빠르지만 실제 작업에선 풀 5.3보다 “멍청하다”고 보고했다(giffmana). -

Lockdown Mode for ChatGPT: OpenAI는 프롬프트 인젝션(prompt-injection)과 데이터 반출 위험을 줄이기 위해 도구 동작을 비활성화/변경(예: 캐시 브라우징, 웹 상호작용 축소)하는 Lockdown Mode를 도입했다. 우선 Enterprise/Business에 제공하고, 이후 소비자에도 제공 예정이다(cryps1s). 이는 툴 결합 LLM이 공격면을 확대한다는 점을 제품 차원에서 인정한 사례이기도 하다.

-

Scientific-claim scrutiny: GPT-5.2가 관여한 것으로 알려진 OpenAI 물리학 결과에 대해 재현성 우려를 제기하며, 비공개 모델을 쓰는 경우 학술지가 대화 로그/툴링 세부를 요구해야 한다는 스레드가 나왔다(lewtun). Kevin Weil은 해당 물리학자의 추가 설명을 가리켰고(kevinweil), gdb는 “어떻게 그렇게 됐는지” 후속 글을 올렸다(gdb).

China’s “holiday model wave”: Qwen3.5, GLM-5, MiniMax M2.5, Seed/Seedance—and robotics acceleration

-

Chinese New Year as release season: 여러 글이 CNY(중국 설)를 새로운 “모델 드롭 주간”으로 묘사하며, Qwen3.5, GLM-5, MiniMax M2.5와 DeepSeek-V4 기대를 함께 언급한다(iScienceLuvr; Yuchenj_UW roundup).

-

MiniMax M2.5: throughput + RL signal efficiency: SemiAnalysis는 특정 TTFT 제약 하에서 8×H200과 vLLM로 M2.5가 ~2500 tok/s/GPU 처리량을 유지했다고 보도했다(SemiAnalysis_). MiniMax는 per-token process rewards가 RL 신호 활용과 비용 효율에 유리하다고 강조하며, 광범위한 API/파트너 가용성을 축하했다(MiniMax_AI).

-

ByteDance Seed/Seedance & AI film: Seedance 2.0은 모델로 제작된 Jia Zhangke 단편을 통해 문화적 순간으로 부상했다(FrankYan2; EHuanglu). 메타 포인트는 비디오 생성이 “장난감 데모”에서 “영화 제작 워크플로”로 이동 중이며, 일부는 이미지 생성보다 비디오 출력이 덜 “aesthetic-guidance uncanny”하다고 느낀다는 점이다(jd_pressman).

-

Robotics: Unitree + broader China lead narrative: 춘절 갈라에서의 Unitree 휴머노이드와 중국 로보틱스 진전이 부각됐다(HumanoidHub; kimmonismus). teortaxesTex는 “포템킨(Potemkin)”식 회의론을 넘어섰으며, 로보틱스를 포함해 특정 아웃라이어가 아니라 산업 전반이 실재한다고 주장했다(teortaxesTex).

-

Compute supply chain signals: Western Digital이 엔터프라이즈 수요로 2026 HDD 생산능력 상당 부분을 매진했으며 일부 AI 고객은 2027/2028까지 예약했다는 보도가 있었다(kimmonismus). 또한 NVIDIA의 GB300 NVL72는 Hopper 대비 ~50× higher performance/MW, ~35× lower cost/token(벤더 주장)이라는 이야기도 나왔다(kimmonismus).

Research/engineering threads engineers actually use (agents, RL, interpretability, and eval hygiene)

-

Multi-step tool use is still brittle: SciAgentGym은 도구 상호작용 단계가 늘수록 성공률이 급락함을 보였고, 도구 의존 그래프 위에서의 데이터 합성(SciForge)이 8B 모델의 과학 워크플로 성능을 개선했다(dair_ai). 이는 실무에서의 에이전트 고통 지점이 단일 단계 추론이 아니라 실행 신뢰성이라는 점과 맞닿아 있다.

-

Adaptive reasoning depth for agents: CogRouter는 단계별로 “cognitive depth”를 동적으로 조절하며, 요약에 따르면 에이전트 벤치마크에서 GPT-4o보다 62% fewer tokens로 더 낫다는 보고가 있다(omarsar0).

-

Rubric-based RL (RLVR beyond verifiable domains): 루브릭 기반 RL에 대한 대형 정리 글이 LLM-as-judge에서 구조화된 루브릭으로 가는 흐름을 추적하며 15편+ 논문과 실무 팁을 제시했다(cwolferesearch).

-

Interpretability objective: MonoLoss는 CLIP/SigLIP2/ViTs의 SAE에서 monosemantic 활성화를 장려하는 플러그인 목적함수를 제안해, 다수 latent에서 “MonoScore”를 개선했다고 한다(iScienceLuvr).

-

Benchmark contamination / “local generalization”: 벤치마크 향상이 학습 데이터 확장 및 의미적 근접 중복(near-duplicate)으로 교란될 수 있다는 강조가 재부상했다. 제안된 분해는 benchmaxxing vs usemaxxing vs hidden interpolation vs 진정한 OOD 일반화다(g_leech_). 이는 비전 데이터 중복 제거 경험과 언어에서 “제대로” 하기가 어렵다는 점을 언급한 Lucas Beyer의 문제의식과도 운율을 맞춘다(giffmana).

-

WeirdML time horizons: WeirdML 과제에 대한 METR 영감의 “time horizon” 추정에서, 프론티어 모델의 horizon이 **~24 minutes (GPT-4)**에서 **~38 hours (Opus 4.6)**로 늘고 ~5-month doubling time을 보인다는 수치가 제시됐다(htihle). METR 유사 추정과 대체로 부합한다는 반응도 있었다(scaling01).

Meta themes: open vs closed, labor/education impacts, and “taste” as a new bottleneck

-

Open model momentum vs concentration risks: 오픈 모델이 권력 집중을 줄이고 AGI 경로 다변화를 지킨다는 정서가 반복됐다(TuringPost clip). 동시에 ToS 제약(예: Anthropic의 감시/무기 제한) 논쟁과 “공급망 리스크” 프레이밍도 이어졌다(RyanPGreenblatt; kimmonismus Axios summary).

-

Workforce disruption timelines: Ryan Greenblatt는 대규모 실업이 “2년 내엔 과대평가, 7년 내엔 과소평가”라고 주장하며, 핵심 변곡점은 AI R&D의 완전 자동화(그 이후 인간 인지 노동 가치가 빠르게 붕괴)라고 봤다(thread start).

-

Education/skills anxiety: 학생이 졸업하기 전 학위가 무의미해질 수 있다는 주장(뉴스 요약 트윗으로 확산)이 불확실성을 반영한다(kimmonismus). 또한 통제 실험에서 AI 코딩 도구가 숙련도(mastery)를 낮출 수 있다는 경고도 언급됐다(Anthropic 연구 링크 요약)(dl_weekly).

-

“Taste” and verification as core skills: 모델/에이전트가 커질수록 취향(taste)(좋은 문제/해법 선택)과 검증 능력(미묘한 오류 탐지)이 가장 희소한 인간 차별점이 된다는 강조가 강하다(gdb; Yuchenj_UW). Karpathy는 이를 프로그래밍 언어/정형기법으로 확장해, 번역과 리팩터링이 지배적이 될 것이며 소프트웨어의 많은 부분을 반복해 다시 쓸 수 있고, “LLM에 최적인 언어”가 무엇인지가 열린 질문이라고 했다(karpathy).

Top tweets (by engagement)

- SF walkability discourse: @paularambles

- Anthropic Bengaluru office / India as #2 market: @AnthropicAI

- Qwen3.5-397B-A17B release (Apache-2.0, multimodal MoE, 17B active): @Alibaba_Qwen

- PL/FM + LLMs reshape software translation/rewrite: @karpathy

- “Anthropic hate for open source” viral take: @ThePrimeagen

- Codex growth claim: @sama

AI Reddit Recap

/r/LocalLlama + /r/localLLM

-

Qwen3.5-397B-A17B is out!! (Activity: 973): Qwen3.5-397B-A17B가 Hugging Face에 공개됐다. 네이티브 컨텍스트 길이는

262,144토큰이며 최대1,010,000토큰까지 확장 가능하다고 한다. GGUF 버전도 here에서 제공된다. 커뮤니티는 성능에 대한 기대와 호기심이 크며 실제로 돌려보려는 분위기다. -

Qwen3.5-397B-A17B는 네이티브

262,144토큰 컨텍스트를 제공하고, 최대1,010,000토큰까지 확장 가능하다는 점이 큰 개선으로 언급된다. -

Qwen3.5-397B-A17B의 디코딩 처리량(decode throughput)은 전작 Qwen3-235B-A22B 대비

3.5x~7.2x빠르다고 보고됐다. 대규모 애플리케이션에서 응답시간 단축과 비용 절감으로 이어질 수 있다는 해석이 나온다. -

Qwen3.5-397B-A17B Unsloth GGUFs (Activity: 663): 알리바바의 신규 모델 Qwen3.5-397B-A17B(멀티모달 추론)가

397B파라미터이며, 한 번에17B만 활성(active)이라는 점이 주목받았다.192GB RAM Mac에서3-bit,M3 Ultra+256GB RAM에서4-bit (MXFP4)로 구동 가능하다는 주장도 포함됐다. 공개 글은 Gemini 3 Pro, Claude Opus 4.5, GPT-5.2와의 경쟁을 언급하며 여러 벤치마크(지시 따르기, 다국어 지식, 비디오 추론 등)에서 강하다고 주장한다. 관련 정보는 Hugging Face와 Unsloth에서 확인할 수 있다. 댓글에서는 AutoRound가 성능을 어떻게 끌어올릴지에 대한 궁금증도 나왔다. -

모델이 단순 인사 응답에서도 내부 독백이 길게 나오는 예시가 공유되며 “verbosity(장황함)”가 언급됐다. 정교한 과업에는 도움이 될 수 있지만 단순 상호작용에선 비효율로 이어질 수 있다는 반응도 있다.

-

UD-Q4_K_XL과 MXFP4 포맷 간 직접 비교 벤치마크가 부족하다는 지적이 나왔고, 배포/최적화 선택을 위한 성능 데이터 공백이 드러났다.

-

Why is running local LLMs still such a pain (Activity: 243): 개인 하드웨어에서 Ollama, Llama 같은 로컬 LLM을 돌릴 때 설치 실패, 리소스 제약(특히

7B초과 모델) 등으로 여전히 어렵다는 불만이 정리됐다. Docker/Kubernetes 등 고급 지식이 요구되고, OpenAI’s ChatGPT 같은 서비스 수준의 기능을 프라이버시 친화적으로 대체하기 어렵다는 문제의식이 나온다. 댓글들은 “ChatGPT급 기능을 로컬에서 그대로”는 하드웨어 요구가 본질적으로 크며, LM Studio, Ollama, Lemonade 같은 도구는 설치가 쉬워도 GPU/NPU 등 하드웨어가 핵심 병목이라고 강조한다. -

Anyone actually using Openclaw? (Activity: 1615): Openclaw의 인기가 실제인지(마케팅/조작 아니냐) 의문을 제기하며, 의심스러운 성장 그래프를 here로 제시한다. Openclaw는 여러 API와 MCP 서버를 연결하는 도구로 설명되지만, 혁신이 부족하다는 사용자 경험도 포함됐다. OpenAI가

10 billion에 인수했다는 주장도 회의적으로 다뤄지며, 대체재(예: Ironclaw)에 대한 관심이 언급된다. 비용 측면에선 기본 30분 heartbeat로 API 비용이 반복 발생할 수 있다는 우려도 나왔다. -

You can run MiniMax-2.5 locally (Activity: 784): MiniMax-2.5를 로컬에서 돌리는 가이드 이미지가 공유됐다. 코딩, agentic tool use, 오피스 작업에서 SOTA급을 표방하며

230B parameters(활성10B),200K context window, bf16 무양자화 기준457GB메모리 요구로 설명된다. Unsloth Dynamic 3-bit GGUF로101GB까지 줄여(62%감소) 접근성을 높였다는 점도 포함됐다. 링크는 official documentation와 GGUF models on Hugging Face. 댓글은 로컬 구동의 “현실적” 접근성(하드웨어 비용/요구)이 낮지 않다는 쪽으로 기울었다.

Less Technical Subreddits

대상 서브레딧: /r/Singularity, /r/Oobabooga, /r/MachineLearning, /r/OpenAI, /r/ClaudeAI, /r/StableDiffusion, /r/ChatGPT, /r/ChatGPTCoding, /r/aivideo, /r/aivideo

-

What are you looking forward to? (Activity: 954): 이미지에는 CHOI (@arrakis_ai)가 DeepSeek V4, Gemini 3.1 Pro, GPT 5.3, Sonnet 5, 그리고 “Mystery model”의 임박한 공개를 알리는 트윗이 담겨 있다. AI 개발 타임라인이 급가속 중이며 며칠 내 출시가 기대된다는 뉘앙스다. 댓글에서는 Sonnet 5 루머에 대한 회의(과거 루머가 Opus 4.6 관련이었던 점)와 경쟁 구도에 대한 추측이 나왔다.

-

Attackers prompted Gemini over 100,000 times while trying to clone it, Google says (Activity: 1342): 구글은 공격자가 Gemini AI를

100,000회 이상 프롬프트해 복제(clone)하려 했다고 보고했다. 이는 model distillation로 불리는 기법으로, 응답을 대량 수집해 더 싼 모방품을 만들려는 시도다. 구글은 이를 intellectual property theft로 간주하며 (구체를 공개하지 않은) 대응책을 도입했다고 한다. 자세한 내용은 original article 참고. 댓글에서는 distillation의 실효성에 대한 회의와, 웹 스크래핑 데이터로 LLM을 학습한 구글이 IP 침해를 주장하는 아이러니가 함께 언급됐다(관련 논의: The Verge). -

Codex-cli with GPT-5.3 codex xhigh - 5 hours made a fully working GBA emulator in assembly code! (Activity: 717): 사용자가 Codex-cli with GPT-5.3 codex xhigh로

5 hours만에 어셈블리로 동작하는 GBA 에뮬레이터를 만들었다고 주장했다. 프로젝트는 GitHub에 있으며, 모델이 자율적으로 빌드/테스트/디버깅을 수행했다고 설명된다. x86-64 어셈블리 코어와 SDL2용 최소 C 호스트 레이어를 포함하고, SuperMarioAdvance 같은 게임을 대상으로 한다. 계획에는 ARM7TDMI CPU 코어, 메모리 매핑, PPU/APU 구현 등이 포함되며, Linux x86-64에서59.7 FPS같은 성능 수치도 언급된다. 댓글은 성능/비용/호환성에 대한 실무적 질문과, “LLM이 로우레벨 코드를 못 만든다”는 주장에 대한 반례라는 반응이 섞였다. -

Anthropic’s Moral Stand: Pentagon warns Anthropic will “Pay a Price” as feud escalates (Activity: 1059): Anthropic과 Pentagon이 AI 활용 윤리 가이드라인을 두고 충돌한다는 내용이다. Anthropic은 대규모 감시 및 완전 자율 무기 같은 용도를 거부하며 가드레일을 주장하고, Pentagon은 이를 ‘supply chain risk’로 보며 조달 압력으로 안전 규범이 약화되는 “race to the bottom”을 우려한다는 프레이밍이 제시된다. 댓글은 Anthropic의 윤리적 제한을 지지하는 반응과 Pentagon 의도에 대한 회의가 함께 나타난다.

-

Exclusive: Pentagon threatens Anthropic punishment (Activity: 969): 국방장관 Pete Hegseth 하의 Pentagon이 Anthropic을 “supply chain risk”로 지정하겠다고 위협했다는 주장이다. 그렇게 되면 계약업체가 Anthropic과의 관계를 끊어야 하며, Claude가 현재 분류된 군사 시스템에 통합된 유일한 모델이라는 점에서 사업적 타격이 크다는 설명이 붙는다. 갈등은 Pentagon의 더 넓은 사용권 요구와, 프라이버시/자율 무기 관련 Anthropic의 윤리적 우려가 충돌하는 데서 비롯된다고 한다. Read more.

-

Anthropic threatened to sue the guy over his project’s name, twice. Now he’s joined OpenAI and Claws 🦞 are coming for them 🤣🤣 (Activity: 1048): 프로젝트 이름을 둘러싼 Anthropic의 법적 위협을 밈으로 풍자하며, 개발자가 OpenAI로 간 상황을 “승리”처럼 묘사한다. 댓글은 Anthropic은 모델 개발, OpenAI는 제품 중심이라는 대비와, 해당 프로젝트의 독창성/전략적 의미에 대한 회의가 섞여 있다.

-

Sam Altman officially confirms that OpenAI has acquired OpenClaw; Peter Steinberger to lead personal agents (Activity: 2440): Sam Altman이 OpenAI의 OpenClaw 인수를 확인했고, Peter Steinberger가 개인 에이전트(personal agents)를 이끈다고 한다. OpenClaw는 오픈소스 재단으로 전환하되 OpenAI가 지원을 이어간다는 설명이 포함된다. 댓글에서는 경쟁사 견제를 위한 ‘defensive buy’ 가능성과, 왜 내부에서 만들지 않았는지에 대한 추측이 나온다.

AI Discord Recap

gpt-5.1이 작성한 “요약의 요약”을 기반으로 한 요약.

Frontier, Open, and Regional Models: Qwen3.5, GLM‑5, MiniMax 2.5, Opus 4.6, Step 3.5 Flash

-

Qwen3.5 & Qwen3.5‑397B A17B Benchmax the Open‑Weight World: 알리바바 Qwen 팀은 Qwen3.5‑397B‑A17B를 공개했다. linear attention + sparse MoE 하이브리드 오픈 가중치 모델로 201 languages를 지원하며, their Qwen3.5 post를 통해 발표됐고 Latent Space 및 HuggingFace 디스코드 등에서 광범위하게 언급됐다. Apache‑2.0 가중치가 GitHub/Hugging Face에 공개되고 API 접근도 제공된다는 얘기가 공유됐다. Unsloth와 Latent Space에서는 이를 새로운 벤치마크 타깃으로 삼으며 “this is qwen, we benchmax here!” 같은 농담도 오갔고, weirdcore 및 고추론(High‑Reasoning)로 “abliterated”된 Qwen3‑30B 변형으로 ****Qwen3‑30B‑A3B‑Claude‑4.5‑Opus‑High‑Reasoning‑2507‑ABLITERATED‑UNCENSORED‑V2 같은 링크도 공유됐다.

-

MXFP4 양자화(quants)와 Q8_K_XL을 비교하는 대화에서, Nemotron 30B A3B에서 MXFP4가 bf16 대비 더 낮은 KL divergence를 보인다는 언급이 있었고, 구형 모델 전반에 MXFP4 지원이 필요하다는 요청이 나왔다. 동시에 Qwen3 아키텍처를 GPT‑NeoX에 구현하는 실험도 공유됐다(this implementation branch). Eleuther 연구 채널에서는 “Matrix‑Driven Identification and Reconstruction of LLM Weight Homology”, “Independence Tests for Language Models” 같은 논문을 해부하며, Qwen 계열을 대규모 오픈 패밀리의 finetuning tree와 프로비넌스(provenance) 복원 사례로 다뤘다.

-

GLM‑5, MiniMax 2.5, and Windsurf’s Model Buffet: OpenClaw, Unsloth, GPU MODE, Windsurf 전반에서 GLM‑5와 MiniMax 2.5가 스트레스 테스트되었다. GLM‑5는 “매우 똑똑하고 chatty(말이 많다)”며, 가용할 때는 Kimi K2.5보다 낫다는 평가도 있었다. MiniMax 2.5는 sparse‑MoE 기반 200k context를 내세우며 ~200 GB VRAM(예: 2× RTX 6000 Blackwell 96 GB에서 120–130 tok/s)이 필요하다는 언급이 나왔다. Windsurf는 IDE 내에서 GLM‑5와 MiniMax M2.5의 1급 지원을 발표하며(their update) IDE를 멀티 프로바이더 프론티어 모델 라우터처럼 만드는 흐름으로 읽혔다.

-

Unsloth 사용자들은 MiniMax 2.5를 Opus 4.6과 비교하며 품질 향상이 거대한 VRAM 풋프린트를 정당화하는지 토론했고, 일부는 sparse MoE 가중치를 시스템 RAM으로 오프로딩(offloading)해 속도와 용량을 맞바꾸는 실험을 했다. OpenRouter 논의에서는 tool-calling에선 GLM이 대체로 더 낫고 MiniMax는 짧은 상호작용에선 더 빠르다는 비교가 나왔으며, GLM 4.5 Air로 커널 코드용 SFT 데이터(저렴한 고품질 reasoning trace)를 만들기 시작했다는 언급도 있었다.

-

Opus 4.6 and Step 3.5 Flash Flex Long Context Muscle: Opus 4.6은 1M-token context와 명시적인 “check your work” 검증 패스를 내세웠고, LMArena에서는 large code instruction suites 같은 입력으로 장문 코드 지시를 넣어 최종 추론에서 초반 실수를 무시/수정할 수 있는지 시험했다. Perplexity 사용자 벤치마크에서는 Opus 4.6이 강력하지만 Anthropic의 시간당 제한(예: “only 18 replies left”)이 대화형 과중 사용의 현실적 제약으로 언급됐다. OpenRouter 쪽에선 Step 3.5 Flash가 YouTube benchmark에서 “punching above its weight”로 호평을 받았지만, 의외로 호스팅이 많지 않다는 지적도 있었다. 또 LMArena에서 요청이 조용히 “5.2” 변형으로 라우팅되는 문제가 발견되며, 투명한 버전 고정(version‑pinned) 접근 요구가 강화되는 흐름도 함께 언급됐다.

Agent Stacks, Planning Frameworks, and Multi‑Agent Systems

-

OpenClaw Orchestrates Autonomous Agencies and Video Calls: 빌더들은 OpenClaw를 멀티 에이전트 팀과 실제 운영을 위한 오케스트레이션 레이어로 보여줬다. 예로, 기술 리드/백엔드/프런트엔드 봇이 작업과 플랜을 공유하며 협업하는 “agency server” 데모가 있었고, 공유 리소스로 planbot resource repo가 언급됐다. 또 한 사용자는 OpenClaw가 Proxmox 호스트에 root SSH로 접속해 Proxmox 6 → 8 업그레이드를 재부팅/에러 처리까지 포함해 엔드투엔드로 수행했다고 보고하며, 운영 수준 신뢰의 사례로 제시했다.

-

별도의 video‑call mode 플러그인은 tavus.io의 아바타를 OpenClaw의 BYO LLM chat‑completions에 연결해, 에이전트가 표정/제스처/화면 공유 내용을 실시간으로 추적하는 데모로 소개됐다. 다른 실험으로는 OpenClaw의 “subconscious”를 과거 모든 채팅으로 학습한 로컬 파인튜닝 LLM에 연결하는 시도가 있었고(에세이는 Google Drive folder로 공유), 유튜브를 스크래핑해 Brian‑Dean 스타일 글 **300+**를 생성하고 편집자 서브에이전트를 거쳐 저장/발행하는 SEO 파이프라인도 언급됐다.

-

From Claude Cowork and DSpy RLMs to Triall’s Model Melee: Latent Space 빌더 채널에서는 Claude Cowork가 파이프라인(예: Zoom 녹화 업로드→유튜브 채널 퍼블리시)을 오케스트레이션하는 사례가 공유됐고, “Claude Cowork might be AGI” 같은 도발적 프레이밍도 나왔다. 또 this repo의 Ergo 플래닝 스킬로 멀티스텝 기능 작업을 구조화하는 사례가 언급됐다. DSpy 기여자들은 Omar Khattab의 스레드(Omar Khattab’s thread)에서 설명된 **Recursive Language Models (RLMs)**를 밀었는데, 이는 단일 거대 harness나 quadratic attention 대신 “모델이 코드를 써서 다른 모델을 호출”하는 방식이다. 구체 예로 dspy‑repl prototype이 공유됐고, 언어 + REPL 선택이 RLM 정확도에 미치는 영향을 탐구한다. 한편 Triall(triall.ai)은 clash 위에서 여러 모델을 경쟁시켜 생성/비평/정제를 수행하는 GUI로 소개되며, “맹신 대신 적대적 추론(adversarial reasoning)”을 장려한다고 설명됐다. OpenAI Discord에서는 KOKKI 같은 구조화된 자기 점검 프롬프트와 FORTRESS 프레임워크(MPC에 매핑) 논의도 있었지만, 일부는 “재현 가능한 테스트 harness 없는 롤플레잉”이라고 일축했다.

-

MCP, Tool‑Chaining, and Agent‑Native Infrastructure: MCP Contributors 서버에서는 structured output과 tool schema의 경제/설계를 논의하며, JSON schema를 프롬프트에 넣는 것이 대부분의 LLM API가 네이티브 스키마 지원이 없어 사실상 숨겨진 “token tax”가 된다고 주장했다. 동시에 schema가 없으면 tool‑chaining이 환각된 필드로 무너질 수 있다는 문제도 제기됐다. 결과 타입을 text/image/object로 명시하고, 구조화 객체는 페이로드 밖 메타데이터로 관리하자는 제안이 나왔다. “지난주 수면” 같은 질의에는 전역 상태가 아니라 tool parameter로 timezone/컨텍스트를 전달하자는 권고도 있었으며, stateless MCP 서버 + explicit client context 패턴을 강화한다. 에이전트 네이티브 인프라 흐름으로는 Jazz(github.com/lvndry/jazz) 같은 터미널 에이전트, DSPy를 MCP로 감싸는 시도, 그리고 Cloudflare의 실험적

Accept: text/markdown지원(“Markdown for agents”) 등이 언급됐다.

GPU Kernels, CUDA/Triton DSLs, and Agent‑Written Kernels

-

FlashInfer, Flashy Contests, and Agent‑Optimized Kernels: GPU MODE의 FlashInfer‑bench 대회에서는 Modal을 통해 B200에서 fused MoE 및 GQA 커널을 튜닝했다. 오거나이저는 레퍼런스 베이스라인이 FP32 intermediate를 사용하지만, 정확도가 충분히 가깝다면 FP8 intermediate는 허용된다고 했고, Modal이 CUDA 12.8을 지원한다고 their docs로 상기시켰다. AccelOpt 팀은 자기개선 LLM 에이전트로 커널을 변이(mutate)시켜 FlashInfer 0.5.3 대비 GQA paged decode 1.5×, paged prefill 1.38× 속도 향상을 주장했고, 접근을 zhang677/AccelOpt로 오픈소스했다.

-

GPU MODE 초급자들은 벤치마크 지터(jitter)(예: H100 matmul이 1400–1500 TFLOPs/s로 출렁임)를 다루며 Achieved Occupancy가 유휴 SM을 무시한다는 점을 발견했고,

sm__cycles_active.sum / sm__cycles_active.max로 활성 SM을 추정하는 식이 공유됐다. HuggingFace 측에선 공식 코스의 에이전트가 H100에서 LTX 모델용 커스텀 CUDA 커널을 작성해 베이스라인을 이겼다는 사례가 “custom CUDA kernels as agent skills” blog로 소개되며, 플래닝 에이전트가 특화 GPU 커널을 설계/통합하는 엔드투엔드 흐름을 보여줬다. -

Triton, CuteDSL, Cutlass, and Proton: Profilers for the Kernel Priesthood: GPU MODE의 triton‑gluon 및 cutlass 채널은 Proton/CuteDSL/CuTeDSL로 깊게 들어갔다. 한 스레드는 example DSL instrumentation로 Proton을 사용해 warp‑level 타임라인을 생성하고 Perfetto에서 시각화하는 과정을 다뤘고, DSL 레벨 주석이 재정렬될 수 있으므로 정밀 작업은 TTGIR override 레벨에 붙여야 한다는 경고가 있었다. 다른 스레드는 CuteDSL의

partition_S가 텐서 정렬을align<16>에서align<4>로 떨어뜨리는 문제와(128,64,4):(1@1,1@0,64@0)같은 이상한 stride 출력, 그리고 CuTeDSLcomplement()가 layout algebra 문서에 나온(3,2):(2,12)대신 잘못된x:x를 반환하는 문제를 디버깅했다(layout algebra docs). -

NVIDIA competition 채널은 상위 5명과 글로벌 베스트(노란색)를 일자별로 그리는 Performance Trends 대시보드를 출시했고, 큰 점수 범위를 읽기 쉽게 축 확대도 추가했다(예시: trend graph). 한편 B200 제출에서 CUTLASS 버전 불일치로

ModuleNotFoundError와DSLRuntimeError를 겪는 사례가 있었고, 문제의 오래된 CuTeDSL 커밋 참조가 here로 공유됐다. 별도의 GPU MODE webgpu 스레드에서는 WebGPU로 M4 Max에서 BitNet‑B1.58을 125 tok/s로 돌리는 Hesper library가 소개됐다. -

Thunderkittens, Tinygrad, and KernelBench as a Data Firehose: Thunderkittens 채널은 TK2 로드맵(현재 Hopper 멀티 GPU 중심)을 두고 A100/4090 지원, FP8 attention, decode 커널, MoE 훈련/추론 커널, gather4용 128‑byte swizzle 같은 미세 최적화를 논의했다. tinygrad에선 George Hotz가 GLM Flash PR을 *“should be 50 lines max”*이며 *“extra unrelated things”*가 많다고 혹평했고, Graphcore C600 IPU를 “20% MFU”, *“accursed C++ slop”*이라 부르며 오픈 스택임에도 non‑CUDA 하드웨어의 마찰을 강조했다.

-

GPU MODE의 popcorn 채널은 커널 튜닝을 데이터셋 팩토리로 만들었다. 한 사용자는 Kernelbook의 reasoning trace를 gpt‑oss‑120B로 생성한 뒤 Arcee Trinity Mini를 Triton 커널 생성에 맞게 파인튜닝했고, 트레이스를 kernelbench‑triton‑reasoning‑traces에 공개했다. 다른 이들은 Qwen3‑30B‑A3B가 원시 커널 과제에 너무 오류가 많아 Kimi‑K2 생성 트레이스에 SFT를 돌려 컴파일 정합성을 3배로 올렸다고 했고, 지금은 4×H100 박스에서 GLM 4.5 Air로 더 많은 SFT 데이터를 만들어 커널 정합성과 추론 깊이를 함께 확장 중이라고 한다.

New Benchmarks, Reasoning Methods, and Uncertainty/Security Research

-

CommonLID, Assistant Axis Drift, and Weight Homology Map Model Behavior: Eleuther와 Common Crawl은 109개 언어를 아우르는 웹 스케일 언어 식별 벤치마크 CommonLID를 공개했고, their arXiv paper에서 기존 LangID 모델이 지원 언어에서도 <80% F1인 경우가 많다고 보고했다. 데이터셋은 Hugging Face에 있다. Eleuther 연구 채널은 또한 “Assistant Axis” 논문 “Steering LLMs by Persona Directions”을 강조했는데, 서로 다른 페르소나의 활성 방향을 추출해 장기 대화에서 assistant-mode drift가 구조적임을 정량화한다. 이와 함께 “Matrix‑Driven Identification and Reconstruction of LLM Weight Homology”, “Independence Tests for Language Models” 및 후속 “Blackbox Model Provenance via Palimpsestic Membership Inference” 같은 이론 스레드도 이어졌고, Independence Tests가 블랙박스 접근으로 Llama 아키텍처 모델의 finetuning tree를 복원할 수 있다는 점에 인상이 모였다. 아울러 this visualization tweet에서 영감을 받아 causal attention preconditioning 근사와 Tensor Core 활용 가능성도 논의됐다.

-

Reasoning Pipelines: CoVe, QED‑Nano, Rubric RL, and RLMs: Latent Space의 페이퍼 클럽은 Meta의 Chain‑of‑Verification(CoVe)를 다뤘고, Ryan Lazuka의 요약 스레드(thread)는 few‑shot exemplar 없이도 2단계 generate→verify 프로토콜로 94% accuracy boosts를 주장한다고 소개했다. Lewis Tunstall의 정리에서 QED‑Nano 4B 정리증명 모델은 IMO급 수학을 겨냥하며, 포스트는 this post로 공유됐다. Cameron Wolfe의 루브릭 기반 RL 서베이는 tweet로 확산됐고, Latent Space의 applied 채널에서는 이를 dspy.RLM 같은 RLM 구상(design thread)과 연결해 “긴 attention보다 호출/코드에 대한 상징적 재귀가 병목을 푼다”는 주장으로 이어졌다.

-

Uncertainty, Password Cracking, and Deception‑Aware Safety: HuggingFace 및 안전 관련 채널에서는 세 개의 Claude Opus 4.5를 병렬로 돌리는 “tri‑brain” 구조의 불확실성 시스템 ATIC이 소개됐고, 문서는 atic.consulting, API 문서는 their API docs로 공유됐다. 같은 채널에서는 PassLLM이라는 패스워드 오디터가 Qwen3‑4B LoRA를 실제 패스워드 쌍 수백만 개로 파인튜닝해 PII 조건부 패스워드 후보를 생성한다는 점이 강조됐고, 오픈소스는 github.com/Tzohar/PassLLM로 공개됐다. Latent Space의 mech‑interp 방에서는 X‑Ware의 meta‑neuron 작업이 논의되었으며, 내부 활성 위의 확산 모델로 활성 편집을 생성하는 접근을 diffusion model over internal activations로 공유했다. 동시에 FAR.AI는 this thread에서 deception probe 학습이 정직성 향상뿐 아니라 텍스트 수준/활성 수준의 은폐(obfuscation)를 유도할 수 있어, 단순한 규제/레드팀이 “내부 상태를 숨기는 모델”을 인센티브할 위험을 경고했다.

Infra, Pricing, and Platform Shifts from Perplexity, Kimi, OpenAI & Stripe

-

Perplexity’s Paywall Pivot and Performance Slide Provoke a Stampede: Perplexity 디스코드에서 Pro 사용자들이 deep search가 월 200→20으로 줄고 파일 업로드 제한, 7일 보관 정책이 생겼다고 강하게 비판했다. 한 파워유저는 기존 처리량을 유지하려면 $20에서 $167/month로 뛴다고 계산했고, TrustPilot 평점이 1.5/5로 떨어졌다는 언급도 나왔다. 또한 2월 6일 이후 장기 메모리 성능이 악화되어 레시피 분량을 잊거나 사실을 만들어낸다는 불만이 나왔다. 대안으로 Anthropic Claude/Opus 4.6로 이동하는 흐름이 있었고(시간당 캡은 여전히 제약), 일부는 Kimi를 코딩/서치 프런트로 실험하며 this shared chat 같은 공유 링크도 돌았다(첫 달 $1 할인 언급 포함). Perplexity API 사용자는 정상 키에서도 401 오류를 겪었고 [email protected]로 메일하라는 안내를 받았다는 얘기가 나와, 가격/신뢰성 모두 엔터프라이즈 중심으로 수렴한다는 불안이 나타났다.

-

Kimi and MiniMax Tangle with Pricing, Quotas, and Local Clones: Moonshot AI의 Kimi 서버와 Unsloth/NouS 채팅에서는 Kimi 2.5/K2.5가 일부 코딩·추론 과제에서 Sonnet/Opus 4.5를 이긴다는 평가와 함께, OpenClaw와 잘 맞도록 튜닝된 API를 노출하는 $40/month 플랜이 언급됐다. 반면 과금 과다, 구독 누락, 쿼터 글리치, 느린 지원에 대한 불만도 컸고(예: 구독이 사라져 bug report을 올렸다는 사례), VS Code에서 CLI 통합 버그가 Kimi 문서(Kimi docs)대로

irm https://code.kimi.com/install.ps1 | iex로 설치 후에야 해결됐다는 얘기도 있었다. 또한 kimi.com/membership/subscription 같은 사칭/스캠 사이트가 악성코드를 배포한다는 경고가 있어, 가격과 함께 일부 사용자를 더 저렴한 중국 모델/오픈 가중치 옵션으로 밀어냈다는 논의가 나왔다. -

Stripe, Apple, Anthropic–Pentagon, and OpenAI Deprecations Redraw the Map: Latent Space의 founders 채널에서는 Stripe가 Billing, merchant‑of‑record, 애드온을 합치면 매출의 ~8.3%를 가져간다는 불만이 나왔고, 관련 a Bluesky rant와 an X thread가 공유됐다. stocks‑crypto‑macro 스레드에서는 Apple이 막대한 현금을 쥔 채 다른 기업들이 AI에 캡엑스를 태우도록 두고, 훈련/추론이 commoditize되면 인수/라이선스로 들어올 수 있다는 해석이 있었고, “$2T capex arms race” 맥락의 BuccoCapital’s tweet도 언급됐다. 정책 측면에선 미 국방장관이 ToS 제한(대규모 국내 감시와 자율 무기 금지)을 이유로 Anthropic을 공급자에서 배제하는 방안을 검토한다는 Axios 보도가 링크됐고(Axios piece), PRISM식 우려를 재점화했다. 동시에 Latent Space 및 OpenAI 디스코드에서는 ChatGPT‑4o decommission에 대한 사용자 항의(viral protest post), GPT‑5.2가 때때로 “GPT‑4o‑mini”로 자기 식별하는 혼선, 그리고 OpenAI’s deprecation docs를 근거로 한 GPT‑5.1 sunset 추측이 공유되며, 불투명한 라이프사이클 결정이 앱 빌더의 1차 운영 리스크가 됐다는 인식이 드러났다.