요즘 LLM은 흔히 파운데이션 모델이라고 불립니다. 하나의 모델이 번역, 요약, 질의응답, 글쓰기 같은 다양한 태스크를 수행하기 때문입니다. Physical AI도 같은 방향으로 움직이고 있습니다. 로봇도 이제 특정 작업만 잘하는 Specialist에서, 다양한 상황에 적응하는 Generalist로 전환하려는 흐름이 뚜렷해졌습니다.

특수 목적 모델에서 범용 모델로

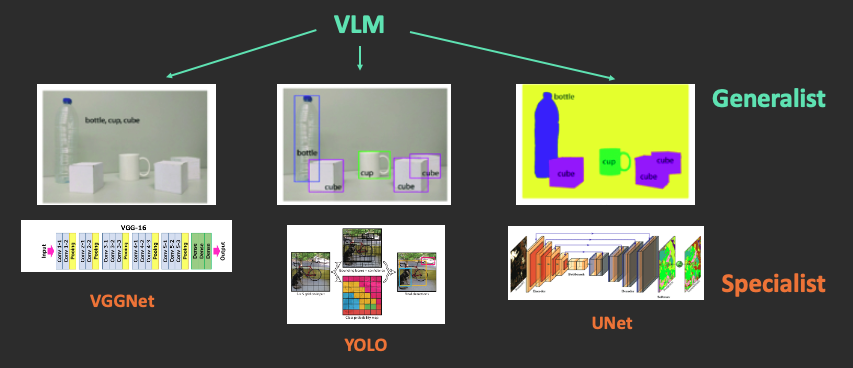

비전(Vision) 태스크를 예시로 생각해보겠습니다. 과거에는 이미지 분류(Image Classification)에 쓰는 모델(예: VGGNet), 객체 탐지(Object Detection)에 쓰는 모델(예: YOLO), 이미지 분할(Image Segmentation)에 쓰는 모델(예: UNet)이 따로 존재했습니다. 이들은 각각 하나의 특수 목적(Specialist)을 위한 모델입니다.

하지만 이제는 하나의 VLM(Vision Language Model, 예: GPT with vision)으로 이 많은 일을 상당 부분 처리할 수 있습니다. 즉, 하나의 범용 모델이 여러 문제를 푸는 방향으로 패러다임이 바뀐 것입니다.

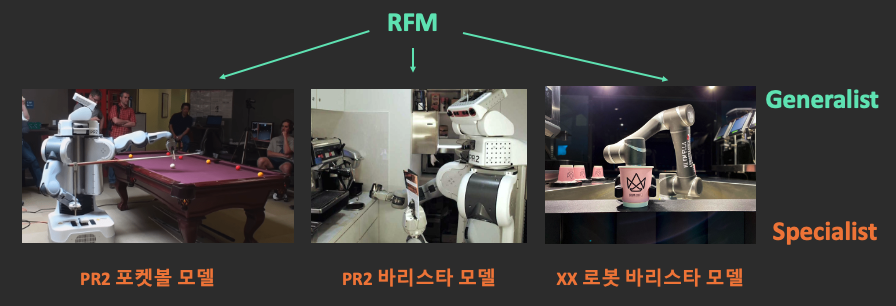

로봇도 마찬가지입니다. 과거에는 특정 태스크, 특정 신체 구조(Embodiment)마다 별도의 모델이나 규칙 기반(rule-based) 로직이 있었습니다. 이제는 하나의 범용적인 모델, 즉 로봇 파운데이션 모델(Robot Foundation Model)이 다양한 일과 다양한 몸체를 처리하고자 합니다.

이러한 전환은 왜 일어나고 있으며, 어떻게 가능해졌을까요? 먼저 Specialist와 Generalist의 차이부터 정리해보겠습니다.

특수 목적 모델과 범용 모델의 정의

특수 목적 모델(Specialist)

특수 목적 모델(Specialist Model): 특정 태스크, 특정 환경, 특정 물체에서만 동작하는 모델

특징:

- 학습 데이터와 동일한 조건에서만 작동

- 환경 변화에 취약 (조명, 배경, 물체 위치)

- 새로운 태스크 지원에 재학습 필요

- 높은 성능이지만 좁은 적용 범위

특수 목적 모델은 정해진 범위 안에서는 매우 뛰어난 성능을 보이지만, 그 범위를 벗어나면 급격히 취약해집니다. 실제 환경은 늘 변동성이 크기 때문에, 이러한 특성은 배포 단계에서 큰 제약이 됩니다.

범용 모델(Generalist)

범용 모델(Generalist Model): 다양한 태스크, 환경, 물체에서 동작하는 범용 모델

특징:

- 학습하지 않은 새로운 상황에서도 적응

- 제로샷(Zero-shot) 또는 퓨샷(Few-shot) 일반화

- 세계 지식(World Knowledge) 기반 추론

- 넓은 적용 범위이지만 특수 목적 모델 대비 낮을 수 있는 개별 성능

범용 모델은 학습 시 보지 못한 상황에서도 유연하게 대응할 가능성이 높기 때문에 실제 환경 배포에 더 적합합니다. 그렇다면 왜 지금에서야 범용 로봇 모델이 가능해진 것일까요?

왜 지금 범용 모델이 가능해졌나

범용 로봇 모델이 최근에야 가능해진 데에는 세 가지 핵심 요인이 있습니다.

사전학습된 VLM의 세계 지식

VLA는 PaliGemma, Qwen-VL, SmolVLM 등 사전학습된 VLM(Vision Language Model)을 백본(backbone)으로 사용합니다. 이 VLM들은 인터넷의 방대한 이미지-텍스트 데이터로 학습되어 이미 “세상에 대한 상식”을 어느 정도 갖고 있습니다.

- 물체 인식: “이것은 컵이다”

- 물리 상식: “컵을 기울이면 물이 쏟아진다”

- 언어 이해: “빨간 컵을 집어라”와 같은 명령 해석

이러한 세계 지식 덕분에 로봇은 처음 보는 물체나 환경에서도 적절한 행동을 추론할 수 있게 되었습니다. VLM이 이미 세상에 대한 풍부한 이해를 가지고 있기 때문에, 로봇은 모든 것을 처음부터 다시 배울 필요가 없습니다.

교차 신체(Cross-Embodiment) 데이터셋

Open X-Embodiment와 같은 대규모 멀티로봇 데이터셋의 등장으로, 다양한 로봇 형태에서의 경험을 공유할 수 있게 되었습니다.

| 데이터셋 | 로봇 수 | 태스크 수 | 에피소드 |

|---|---|---|---|

| Open X-Embodiment | 22+ | 527 | 1M+ |

| DROID | 7 | 500+ | 76K |

| BridgeData V2 | 1 | 13 | 60K |

표: 대표적인 교차 신체(Cross-Embodiment) 데이터셋 비교 — 로봇 수, 태스크 수, 에피소드 규모

여러 로봇의 데이터를 함께 학습하면, 특정 로봇에서 배운 지식이 다른 로봇에도 전이될 수 있습니다. 이는 각 로봇 제조사가 개별적으로 데이터를 수집해야 하는 부담을 크게 줄여주며, 궁극적으로는 새로운 몸체에도 적응 가능한 범용 모델로 이어집니다.

스케일링 법칙(Scaling Law)의 적용

LLM에서 증명된 스케일링 법칙이 VLA에도 적용될 것이라는 기대가 있습니다. 아주 단순하게 요약하면 다음과 같습니다.

- 더 많은 데이터 → 더 나은 일반화

- 더 큰 모델 → 더 복잡한 태스크 처리

- 더 다양한 경험 → 더 넓은 적용 범위

이 세 가지 요인이 결합되면서, 이전에는 불가능했던 범용 로봇 모델이 현실로 다가오고 있습니다. 특히 LLM의 성공은 “로봇도 비슷한 방식으로 확장될 수 있다”는 강한 확신을 업계에 제공했습니다.

현재 VLA들의 일반화(Generalization) 수준

다양한 연구팀과 기업들이 VLA의 일반화 능력을 검증하고 있습니다. 대표적인 사례들을 살펴보겠습니다.

Pi0.5: 개방 세계(Open-World) 일반화

Physical Intelligence의 Pi0.5는 학습하지 않은 완전히 새로운 가정에서도 동작함을 보여줬습니다. 이는 VLA가 단순히 학습 데이터를 암기하는 것이 아니라, 진정한 의미의 일반화를 달성하고 있음을 시사합니다.

- 새로운 가정 환경

- 새로운 물체

- 새로운 배치

Pi0.5의 개방 세계 일반화 시연 — 2025년 4월 22일

새로운 집, 새로운 물체 배치, 새로운 작업 흐름에서도 일정 수준의 성공과 실패 사례를 함께 공개했다는 점이 중요합니다. 일반화는 단순히 “처음 보는 환경에서도 가끔 된다”가 아니라, 실제 세계의 변동성을 견디는 방향으로 나아가고 있다는 신호이기 때문입니다.

GR00T: 교차 신체(Cross-Embodiment) 일반화

NVIDIA의 GR00T 시리즈는 다양한 로봇 하드웨어에서의 일반화를 목표로 합니다. 하나의 모델이 여러 종류의 로봇에서 작동할 수 있다면, 로봇 개발의 비용과 시간을 크게 줄일 수 있습니다.

SmolVLA: 효율적 범용 모델

HuggingFace의 SmolVLA는 450M 파라미터로도 범용 모델 수준의 성능이 가능함을 보여줍니다. 이는 엣지 디바이스에서의 배포 가능성을 열어주며, 고성능 GPU 없이도 로봇에서 직접 추론이 가능함을 의미합니다.

이처럼 다양한 접근 방식에서 범용 모델의 가능성이 검증되고 있으며, 각각 다른 측면에서 일반화의 한계를 넓혀가고 있습니다.

특수 목적 모델 vs 범용 모델: 트레이드오프

두 접근 방식은 각각 장단점이 있으며, 상황에 따라 적절한 선택이 달라집니다.

| 측면 | 특수 목적 모델(Specialist) | 범용 모델(Generalist) |

|---|---|---|

| 개별 태스크 성능 | 높음 | 중간~높음 |

| 적용 범위 | 좁음 | 넓음 |

| 배포 비용 | 태스크당 높음 | 낮음 (하나로 여러 태스크) |

| 학습 비용 | 낮음 | 높음 |

| 유지보수 | 태스크별 관리 | 통합 관리 |

표: 특수 목적 모델과 범용 모델의 트레이드오프 비교

현실적으로는 두 접근 방식 중 하나만 선택하기보다, 상황에 맞게 조합하는 것이 효과적입니다. 예를 들어, 범용 모델을 기반으로 특정 태스크에 파인튜닝하는 방식이 점점 더 일반화되고 있습니다.

앞으로의 방향

파인튜닝(Fine-tuning): 범용 모델에서 특수 목적으로

사전학습된 범용 모델을 특정 태스크에 파인튜닝하는 방식이 부상하고 있습니다:

- 범용 VLA로 기본 능력 확보

- 적은 데이터로 특정 환경/태스크에 적응

- 특수 목적 모델 수준 성능 + 범용 모델의 기반 지식

이 접근 방식은 범용 모델의 넓은 지식 기반 위에 특수 목적 모델의 높은 성능을 더하는 효과가 있습니다. LLM 분야에서 범용 모델을 특정 도메인에 맞게 미세 조정하는 흐름과 매우 유사합니다.

장기적으로는 파인튜닝 없이도 다양한 태스크를 높은 성능으로 수행하는 것이 이상적인 방향입니다. RFM이 지향하는 미래도 결국 그쪽에 가깝습니다.

코트레이닝(Co-training): 다양성의 힘

웹 데이터, 시뮬레이션 데이터, 로봇 데이터를 함께 학습하여 일반화 능력을 강화하는 방식입니다. 다양한 출처의 데이터가 서로 보완하여 더 견고한 모델을 만들어냅니다.

NVIDIA의 GR00T처럼 이런 코트레이닝 전략을 적극적으로 사용하는 사례도 이미 등장하고 있습니다.

특수 목적 모델에서 범용 모델로의 전환은 로봇 AI 발전의 핵심 트렌드입니다. 이 전환이 성공적으로 이루어진다면, 로봇은 더 이상 제한된 환경에서만 동작하는 기계가 아니라 우리의 일상 속에서 다양한 역할을 수행하는 시스템이 될 것입니다.

다음 문서

범용 로봇을 구현하는 핵심 기술인 VLA에 대해 자세히 알아봅시다.

다음: RFM & VLA란 무엇인가